AI-терапевтам нужны правила

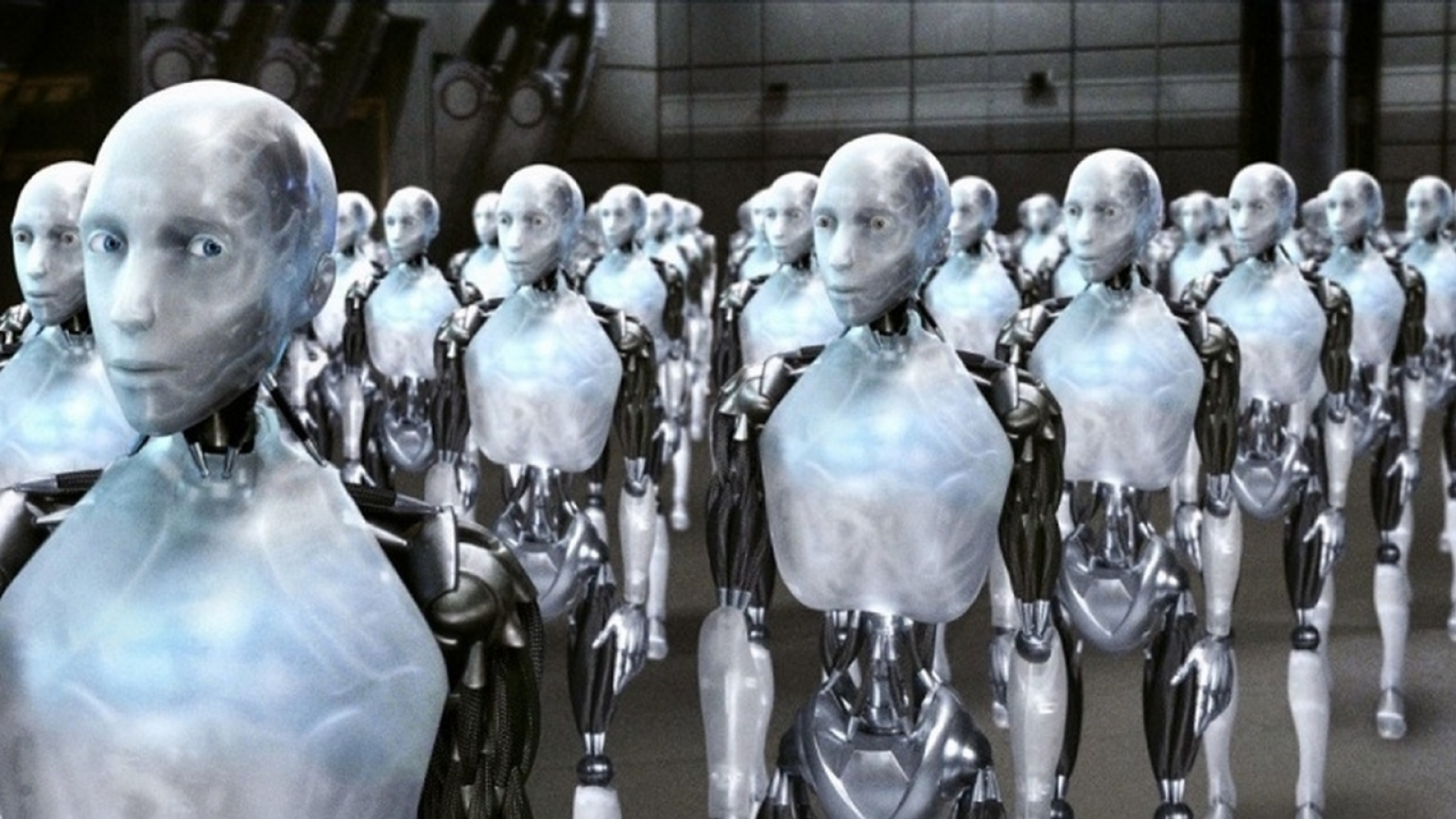

Взаимодействие с искусственным интеллектом (artificial intelligence, AI) станет уже в ближайшем будущем привычным элементом нашей жизни.

![AI-терапевтам нужны правила [1]](/frontend/web/src/img_btx/07102014/x_98d38247b04a507a5bc2b72be0fa28b9.png)

Взаимодействие с искусственным интеллектом (artificial intelligence, AI) станет уже в ближайшем будущем привычным элементом нашей жизни. Но пока еще многое надо сделать, прежде чем допустить "роботов" в нашу жизнь.

Немецкие специалисты из Технического университета Мюнхена недавно завершили исследование того, как "воплощенный AI" может помочь в лечении психических заболеваний. И они пришли к выводу, что важные этические вопросы, связанные с этой технологией, остаются пока без ответа. Существует настоятельная необходимость в действиях со стороны правительств, профессиональных ассоциаций и исследователей.

Уже существуют многочисленные программы, использующие" воплощенный искусственный интеллект" для улучшения психического здоровья. Эти приложения называются воплощенными, поскольку они предполагают взаимодействие между людьми и искусственным агентом, запрограммированной системой, что приводит к совершенно новой динамике. Это и куклы-роботы, которые учат детей с аутизмом лучше общаться, компьютерные аватары*, которые помогают пациентам справляться с галлюцинациями, и виртуальные чаты, предлагающие поддержку при депрессии. Алгоритмы, лежащие в основе этих новых приложений, были обучены с помощью огромных наборов данных и могут делать подлинные терапевтические заключения.

![AI-терапевтам нужны правила [2]](https://evercare.ru/sites/default/files/upload/0f8cd1be-e538-4c0d-bc88-a457bbce28dd_tv_w1200_r1_s.jpg)

Эти новые технологии обладают огромным потенциалом. Они могут сделать лечение доступным для большего числа людей, поскольку они не ограничиваются конкретным временем или местом. Кроме того, некоторым пациентам даже легче взаимодействовать с AI, чем с человеком. Но есть и риски. Как говорит один из авторов исследования доктор Амелия Фиске,

Методы искусственного интеллекта не могут и не должны использоваться в качестве более дешевой замены лечения у врачей-людей. От медицинских ассоциаций все еще очень мало рекомендаций по решению проблемы использования AI-систем в терапии. И для использования преимуществ этих технологий и исключения неблагоприятных последствий необходимы срочные меры. В частности, молодые врачи должны знакомиться с этой темой еще в медицинском училище.

В настоящее время в Европе активизируются усилия по разработке инструкций и правил для использования AI. В частности, в ЕС недавно были изданы "Руководящие принципы этики для надежных систем на базе AI" (Ethics Guidelines for Trustworthy AI). Однако немецкие исследователи считают, что существует острая необходимость в регулировании использования искусственного интеллекта в специализированных областях.

По словам Алены Буикс, профессора этики медицины и медицинских технологий в Техническом университете Мюнхена,

Терапевтические AI-приложения - это медицинские продукты, для которой нам необходимы соответствующие процедуры утверждения и этические принципы. Например, если такая программа может распознать наличие у пациентов суицидальных мыслей, то в случае серьезных опасений она должна следовать четким предупреждающим протоколам, как это делают терапевты.

Кроме того, необходимо провести исследования возможных социальных последствий использования "воплощенного AI". Как говорит доктор Буикс,

У нас очень мало информации о том, как контакт с AI влияет на нас как людей. Например, при контакте с роботом ребенок с расстройством аутистического спектра может научиться лучше взаимодействовать только с роботами, но не с людьми.

* Аватар - искусственное представление живого человека, персонаж, используемый в приложениях на базе искусственного интеллекта для облегчения общения с пользователем программной системы. Происходит от термина "аватара" в философии индуизма, обычно используемый для обозначения нисхождения божества на землю, его воплощение в человеческом облике.

Источник: eHealth News

Источник: https://evercare.ru/